Spiegelnde, durchsichtige oder schwarze Oberflächen sind mit konventioneller Sensorik schwierig bzw. gar nicht zu erfassen. Um das zu umgehen, werden diese Oberflächen bislang für Prüfzwecke oft mit einem matten Lack überzogen, der nach der Prüfung wieder entfernt wird. Für Echtzeitprozesse ist diese Vorgehensweise eher unpraktisch. Ein Ausweg ist die Verwendung von IR-Strahlung. Viele Oberflächen werden dabei opak und lassen sich so vermessen. Am Fraunhofer IOF wurde nun eine Methode entwickelt, die Wärmestrahlung (Wellenlänge 10,6µm) zur Beleuchtung einsetzt. Dabei wird das Licht vom Objekt nicht einfach reflektiert, sondern vor allem absorbiert und emittiert. Normalerweise werden bei der stereoskopischen Erfassung Objekte mit speziellen Streifenmustern flächig beleuchtet und die reflektierte Strahlung mit zwei Kameras synchron aufgenommen. Dank der speziellen Muster lassen sich die 2D-Daten aus den Kameras eindeutig räumlichen Bildpunkten zuordnen. Das technische Grundprinzip, bei dem das Muster durch eine rotierende Scheibe vorgegeben wird, ist auch auf die Infrarotstrahlung (IR) übertragbar. Mit Wärmestrahlung war bisher aber der Kontrast zwischen den Streifen aufgrund der Wärmediffusion begrenzt.

Intensive IR-Streifen

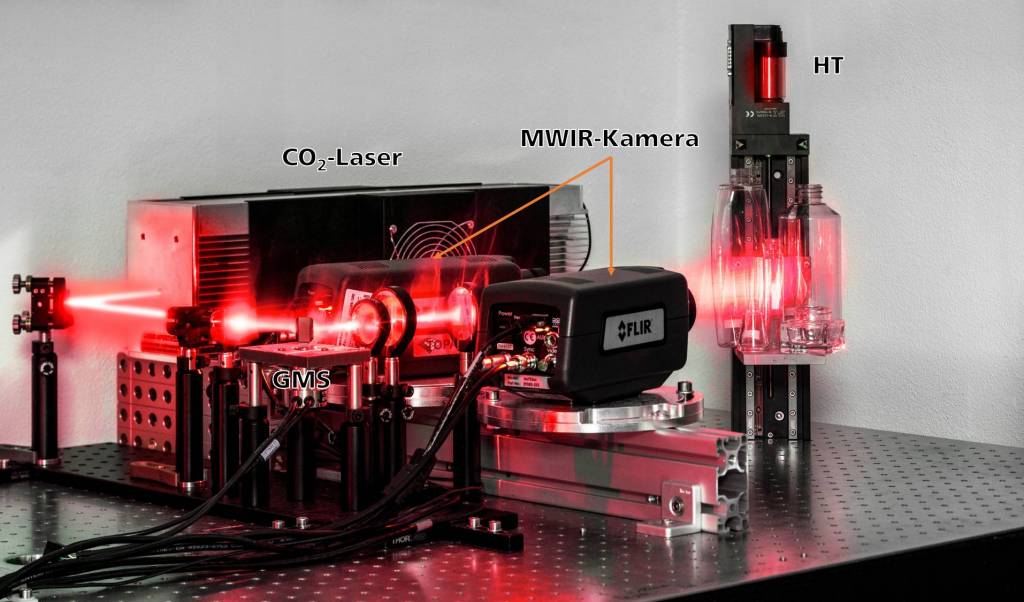

Das Problem kann vermieden werden, wenn statt flächiger Muster nur ein schmaler, aber intensiver IR-Streifen zur Bestrahlung genutzt wird. Dafür nutzt das Fraunhofer IOF einen CO2-Laser, dessen Strahlung über Zylinderlinsen zu einem schmalen Streifen geformt wird. Mit einem schnellen Galvanometerscanner wird diese Linie über das Objekt geführt. Die Objektoberfläche emittiert daraufhin Wärmestrahlung, die mit zwei IR-Kameras im Bereich zwischen 3 und 5µm aufgenommen wird. Die Bestrahlungsstärke im Streifen ist etwa 100x stärker als bei flächigen Mustern, wobei eine Glasoberfläche im Experiment lokal um wenige Kelvin erwärmt wird. Der thermische Streifen hat auf dem Messkörper eine Breite von 1,2mm und wird nach einer Bestrahldauer im ms-Bereich weiterbewegt. Die Zeit für die Wärmediffusion ist wesentlich kürzer als bei flächiger Beleuchtung und dementsprechend höher ist der Kontrast. Messungen wurden bislang an Testkörpern aus Glas und verschiedenen Kunststoffen, wie PMMA, PA oder PP durchgeführt. Die Glasoberfläche erwärmte sich lokal im unteren einstelligen Kelvinbereich mit etwa 3K, im Kunststoff ist der Temperaturanstieg etwas höher. Eine Grenze ergibt sich allerdings derzeit aus der Bildrate der MWIR-Kameras. Die verwendeten Flir A6753sc schaffen maximal 125Hz. Mit den beiden Parametern Kontrast und Geschwindigkeit lässt sich das System auf maximale Genauigkeit oder maximale Geschwindigkeit optimieren.

Bild: Fraunhofer-Institut IOF

Bild: Fraunhofer-Institut IOF

Bild: Fraunhofer-Institut IOF

Bild: Fraunhofer-Institut IOF

Bild: Fraunhofer-Institut IOF

Bild: Fraunhofer-Institut IOF

Interessant für Robotikanwendungen

Bei einer Bildfeldbreite von 160mm (Öffnungswinkel 24°) konnte mit einer Messzeit von 4s und einer entsprechend kleinen Schrittweite eine Genauigkeit unter 12µm für die 3D-Koordinaten erreicht werden. Der Laser ist bei allen Messungen 8ms an und wird anschließend beim Scannen 2ms ausgetastet. Die Schrittweite des Scanners lässt sich erhöhen und damit die Messdauer reduzieren. Mit einer Messzeit unter einer Sekunde ist die Auflösung immer noch bei etwa 50µm. In der Zeit ist der stereoskopische Datensatz aufgenommen. Diese Einstellung ist besonders interessant für Anwendungen in der Robotik, bei denen ein 3D-Sensor in kurzer Zeit korrekte Daten für einen Greifer liefern soll. Derzeit wird ein entsprechender Aufbau bereits getestet. Dabei sollen beispielsweise Dialysefilter automatisch aufgenommen werden, das heißt Kunststoffröhren von 25cm Länge und 6cm Durchmesser. In einer anderen Anwendung soll der 3D-Sensor für das Zusammensetzen alter Glasscherben genutzt werden. Der Sensor erfasst dreidimensional die Scherben, welche im Anschluss über eine Software virtuell zusammen gesetzt werden können. Die IR-Sensortechnologie wird weiterentwickelt: Eine Koppelung einer RBG-Kamera an das System zum Mapping von 2D (RGB-Bild oder Wärmebild) auf 3D-Daten wurde bereits entwickelt und mehrfach erprobt. Weiter geforscht wird auch an einer optimierten Scanning-Strategie und der Robotik-Integration zum Greifen von transparenten Objekten.

www.iof.fraunhofer.de